머신러닝 알고리즘 중에서 가장 단순, 적은 연산으로 훌륭한 성능을 보여주는 분류기 Classifier 이다.

Posterior = Likelihood x Prior / Model Evidence

사후 확률 가능도 사전확률 모델에 대한 증거

H : 가설, E : 증거

베이지안 이론 예제

환자가 Stiff neck 을 가졌다면, meningitis 일 확률은 얼마일까?

meningitis 가 stiff neck 을 발병할 확률은 50%, meningitis 사전 확률은 1 / 50,000, stiff neck 은 1/ 20 이다.

베이지안 이론에 따른 P(M|S) 는 0.5 x 1/50000 / ( 1 / 20 ) = 0.0002 이다.

M : Meningitis = Hypothesis 가설, S : Stiff Neck = Evidence 증거이다.

E = Test +

P = 1 / 1000

Test Acc(Accuracy) = 99%

P ( H | (Given) P) = P(A) * P(P | H) / P(P) = 0.001 * 0.99 / (0.01 * 0.999)[H] + (0.99 * 0.001)[H]

= 0.09 ( 9% )

베이즈 이론에 따른 분류

예제

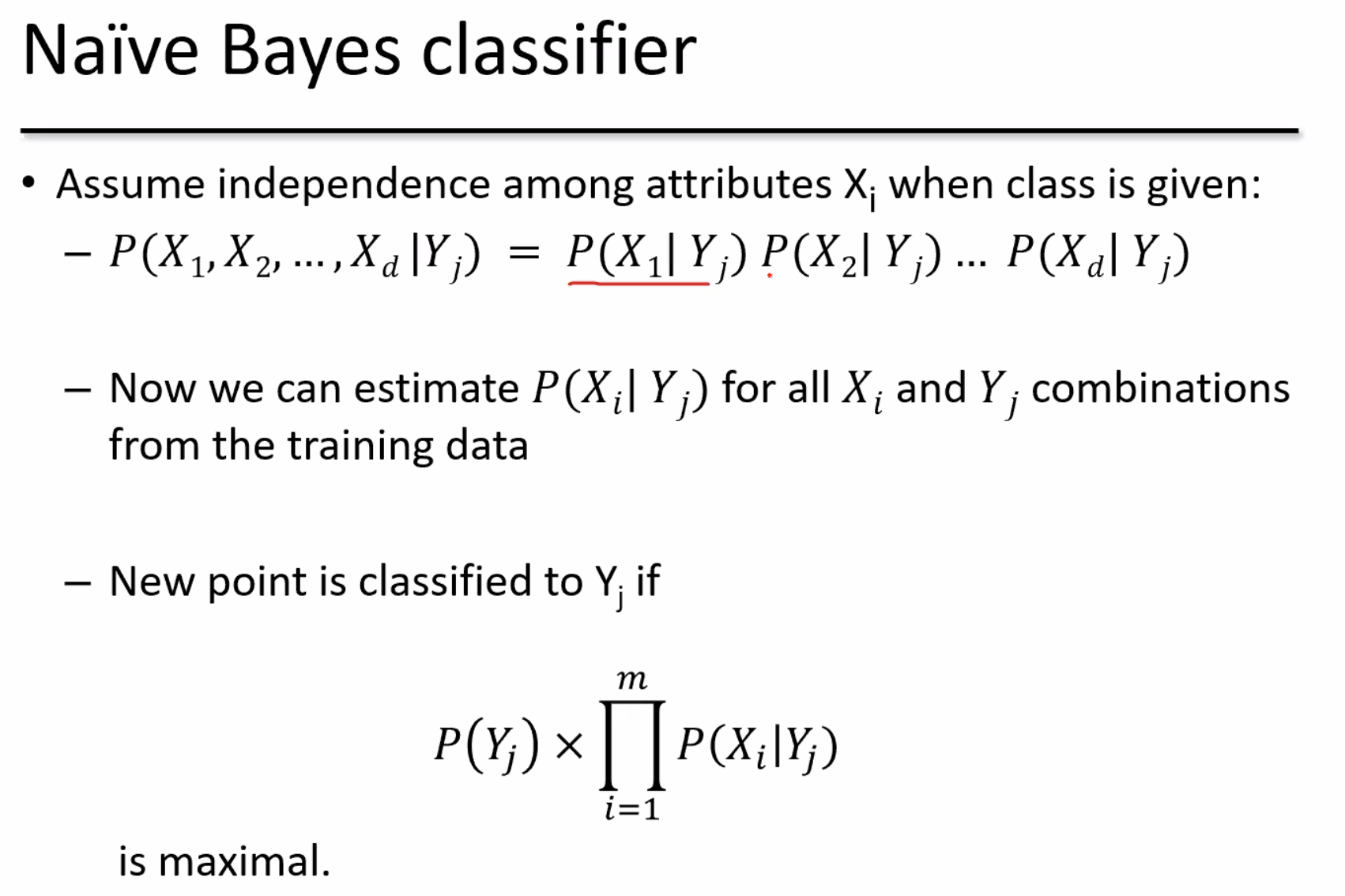

모두 독립이라고 가정하고 관련한 확률을 모두 곱한다.

X의 상태가 Refund = No, Divorced = Yes, Income = 120K 이다.

Yes와 No일때의 값을 모두 곱한다.

Evade 에따라, P(No) = 0.7, P(Yes) = 0.3이다.

Married = 0.4 이기 때문에 P(Married | No) = 4/7 이다. 반대로 둘다 Yes일 경우는 존재하지 않기 때문에 0이다.

Normal Distribution

Refund가 No, Divorced가 Yes, Income 이 120K일때 나이브 베이즈 분류계산은 다음과 같다.

몇몇의 Record가 없을때 Issues.

Record가 존재하지 않아 Probability가 0이라면, 결과값은 0이 발생한다. 나이브 베이즈는 X가 yes이거나 no일때를 분류하는데 적합하지 않다.

Conditional Probabilities 가 0이라면, 모든 표현식은 0이되버리는 문제가 발생한다. 그래서 다음과 같은 Laplace , m-estimate 조건 확률 평가 방식을 필요로하게된다.

Give Brith : Yes, Can Fly : No, Live in water : yes, Have lag : no 인 레코드에 대해 Class 분류?

P(A | M) 에서 6 / 7는 Give Brith가 Yes면서 Mammals인 경우 6/7이다.

'AI Master Degree > Data Mining' 카테고리의 다른 글

| Classification Regression (0) | 2021.10.29 |

|---|---|

| Chap 7. Decision Tree 결정 트리 (0) | 2021.10.20 |

| Midterm Preparation : Data Mining (0) | 2021.10.14 |

| Chapter 3. Data preprocessing이란? (0) | 2021.10.12 |

| Chapter 2. Data 타입이란? Missing value란? Outliers란? (Data Mining) (0) | 2021.10.12 |